▶カタパルトの結果速報、ICCサミットの最新情報は公式Xをぜひご覧ください!

▶新着記事を公式LINEで配信しています。友だち申請はこちらから!

▶過去のカタパルトライブ中継のアーカイブも見られます! ICCのYouTubeチャンネルはこちらから!

ICC FUKUOKA 2025 リアルテック・カタパルトに登壇いただき3位に入賞した、FingerVision 濃野 友紀さんのプレゼンテーション動画【来たるロボット革命の課題を“触覚”で解決する「FingerVision」】の文字起こし版をお届けします。ぜひご覧ください!

ICCサミットは「ともに学び、ともに産業を創る。」ための場です。そして参加者同士が朝から晩まで真剣に学び合い、交流します。次回ICCサミット KYOTO 2025は、2025年9月1日〜9月4日 京都市での開催を予定しております。参加登録は公式ページをご覧ください。

本セッションのオフィシャルサポーターは 慶應イノベーション・イニシアティブ です。

▶【速報】がん治療に新たな未来!超音波治療装置で低負担の治療を可能にする「ソニア・セラピューティクス」がリアルテック・カタパルト優勝!(ICC FUKUOKA 2025)

▼

【登壇者情報】

2025年2月17〜20日開催

ICC FUKUOKA 2025

Session 7A

REALTECH CATAPULT リアルテック・ベンチャーが世界を変える

Sponsored by 慶應イノベーション・イニシアティブ

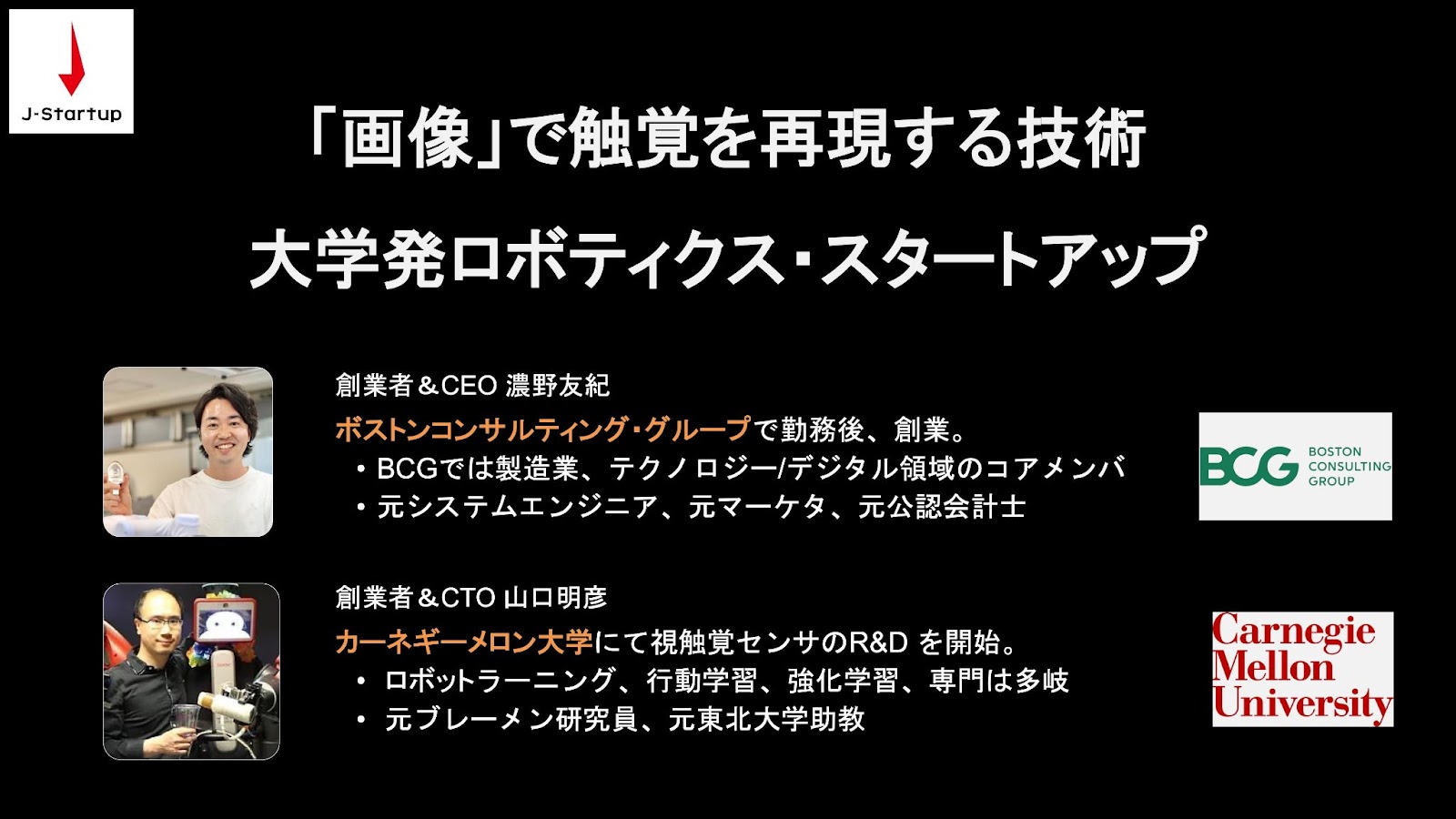

濃野 友紀

FingerVision

代表取締役

公式HP | 公式X

ボストン・コンサルティング・グループ(BCG) にて産業財セクター、テクノロジー/デジタルセクターを中心に多数のプロジェクト(トランスフォーメーション、グローバル展開、M&A、組織設計・構築等)に従事したのちに創業。父親が大学教授であったこともあり、幼少期から「先端技術」に対する思い入れは強い。以前は、NTTデータや電通コンサルティングにてシステム開発やマーケティング・事業構想も経験。

▲

濃野 友紀さん FingerVisionの濃野です。

当社は「画像」で触覚を再現する技術を持つ大学発のスタートアップです。

本日は当社の壮大なビジョンについて、お話しできればと思っています。

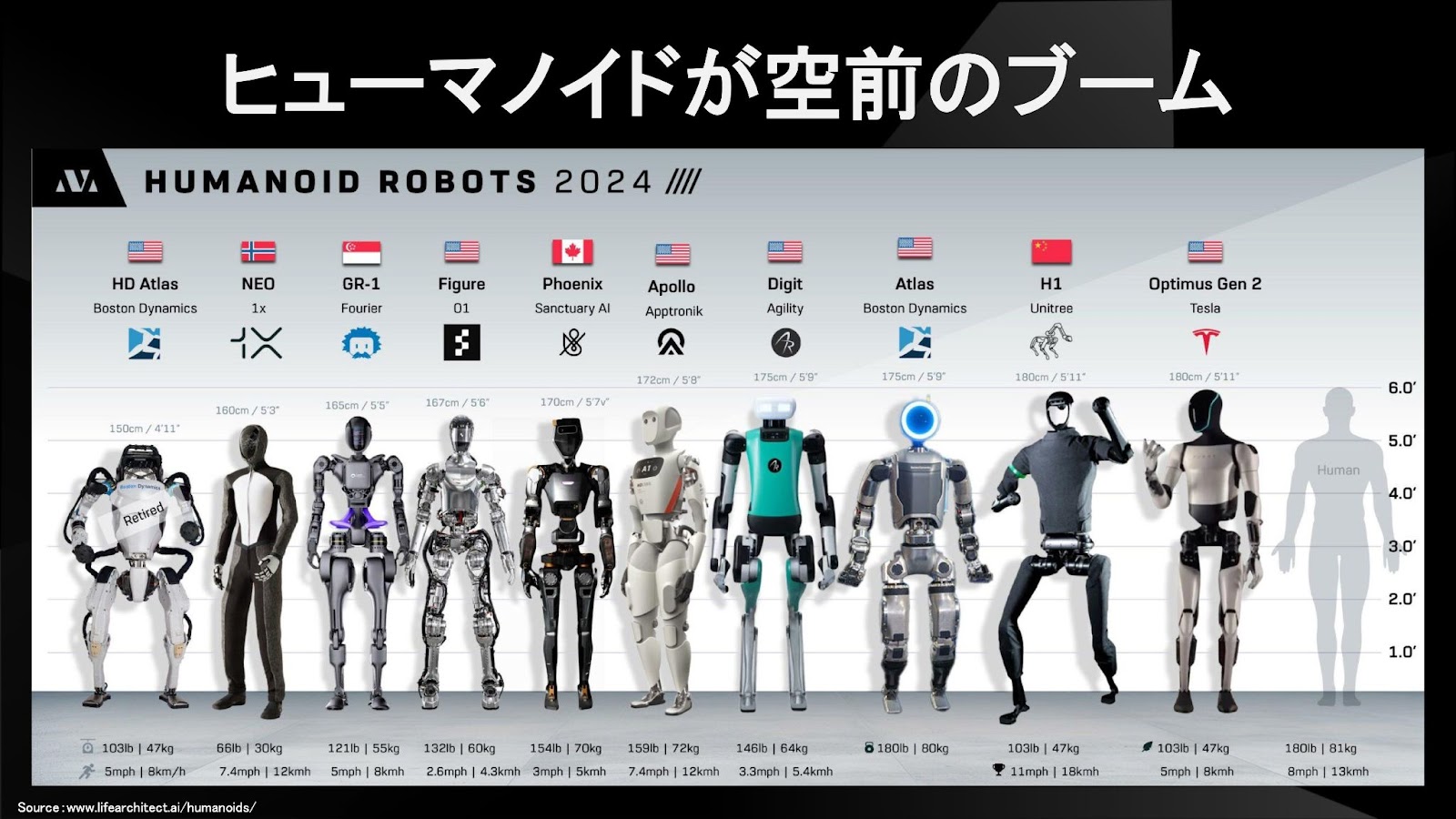

ヒューマノイドが空前のブーム

最初に、こちらはテスラの人型ロボットです。

物を運んだり歩いたり、場合によっては人と会話をしながら、人間がするようなタスクをこなします。

▶「ほぼ人間じゃん」――テスラの人型ロボットが話題 歩いて喋ってジャンケンして、バーテンダーもこなす(ITmedia)

こういった世界が近づいてきています。

実際、今ロボットの世界では、ヒューマノイドが空前の大・大・大ブームになっています。

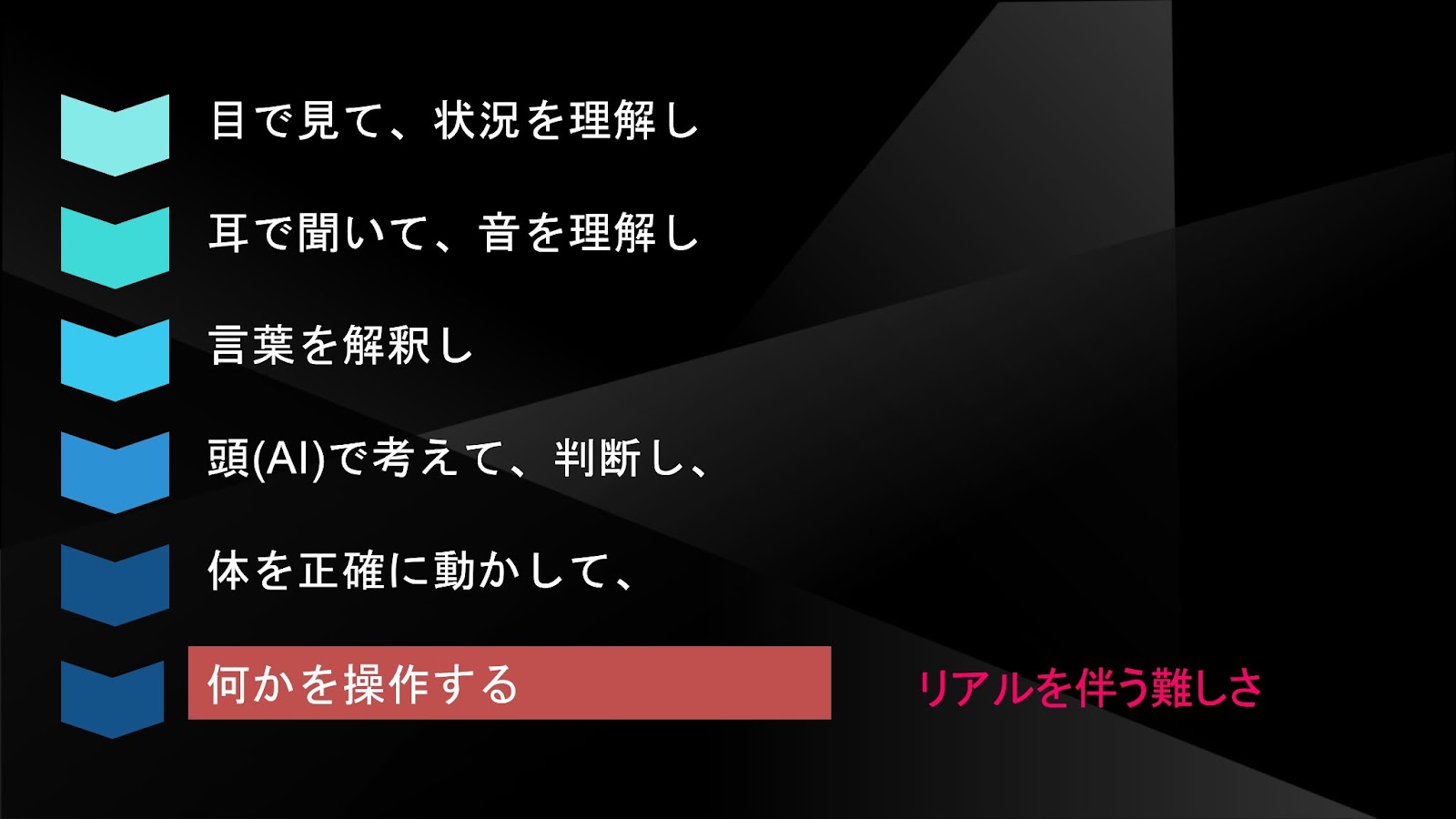

実際に何をやっているかというと、目、耳、口などを駆使して、まさに人間のような仕事をこなします。

本当に、こういった世界が近づいてきています。

ロボットのウィークポイントは「手」

ただ、この中で1つだけ非常に難しいことがあります。

それは何でしょうか?

これです。

「手」です。「何かを操作する」です。

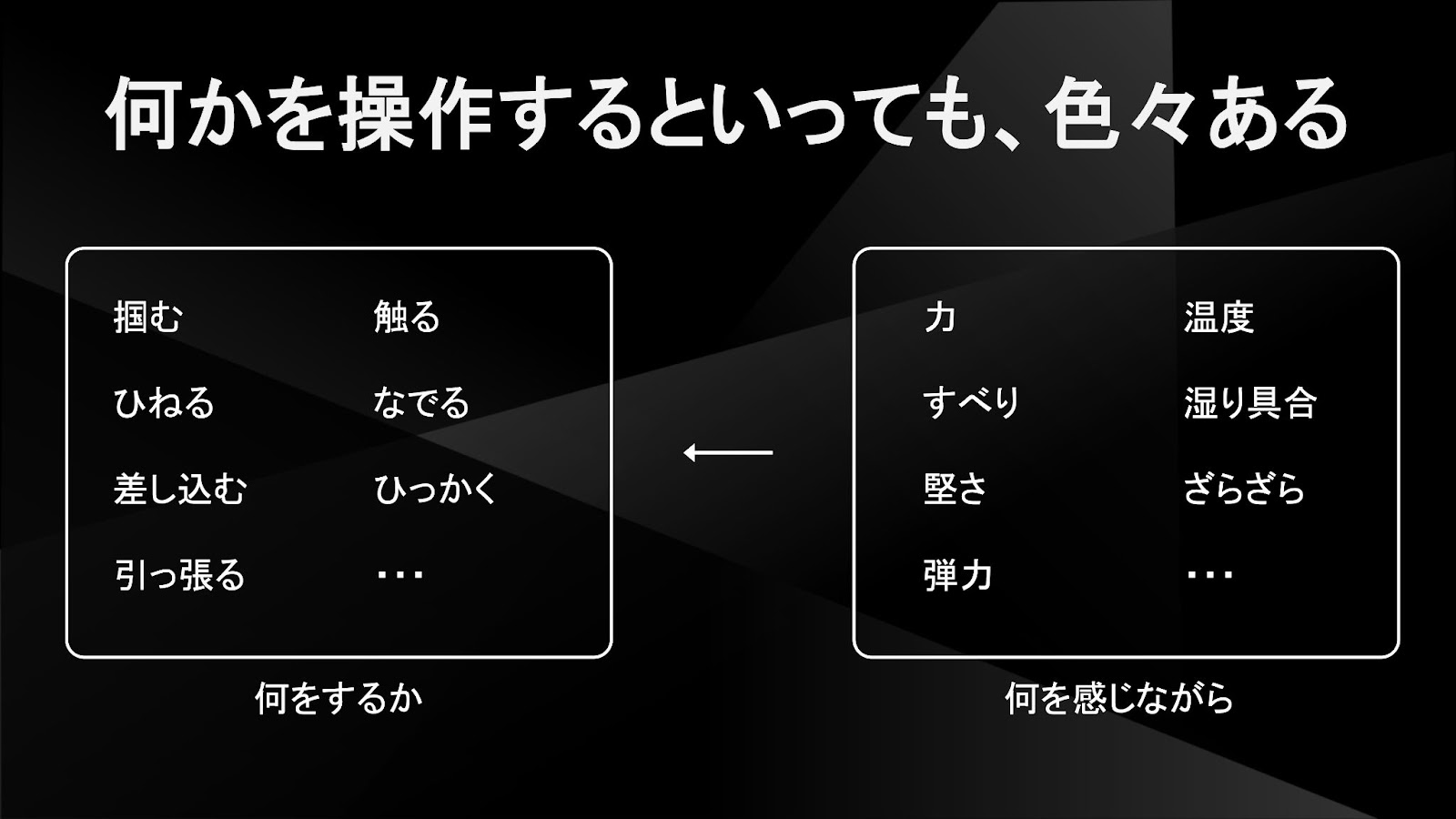

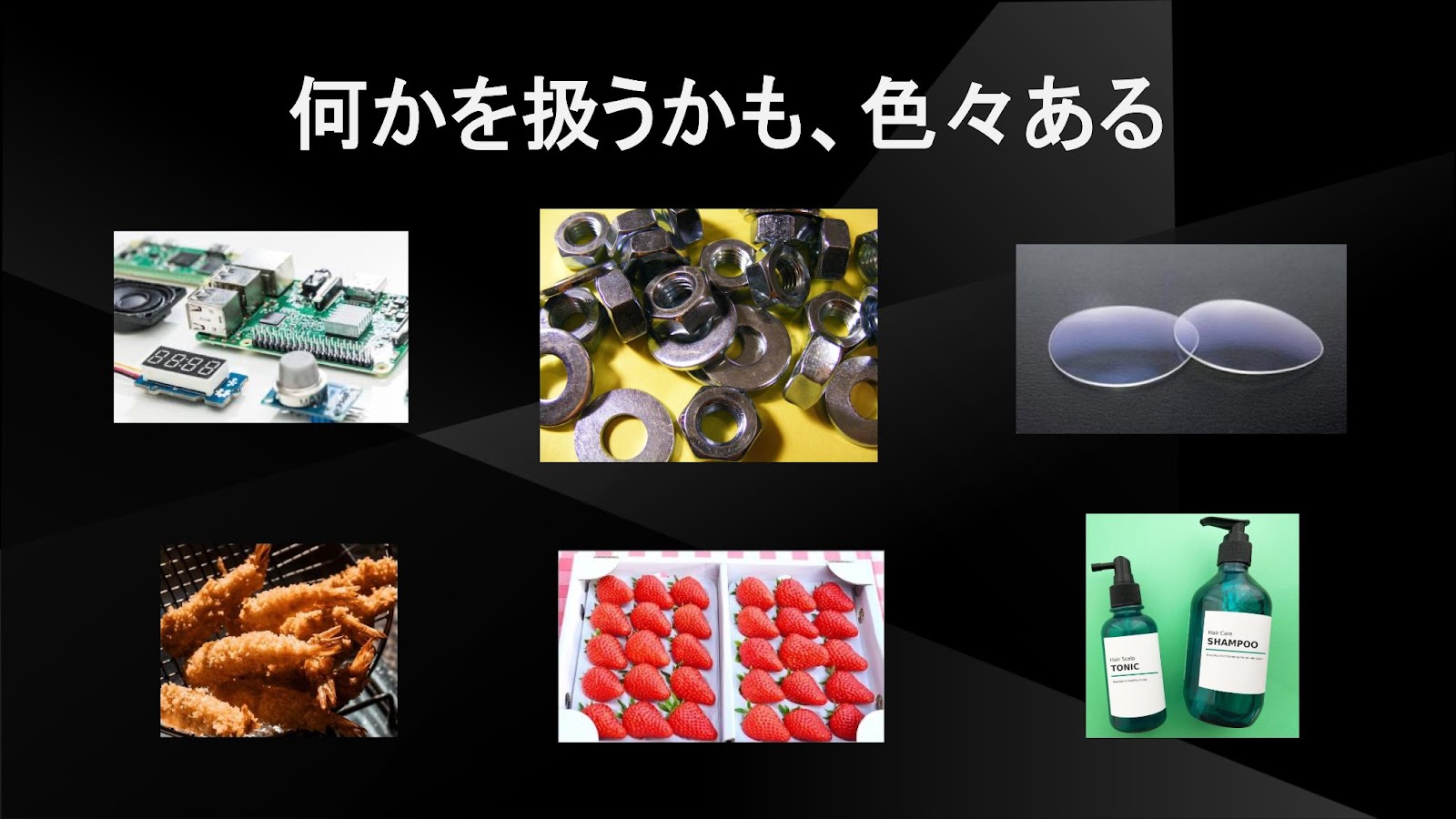

「何かを操作する」といっても、動作自体色々あるし、感じ方もさまざまです。

扱うものも、非常に多岐にわたります。

こういったものを組み合わせると、リアルの世界には無限の組み合わせがあります。

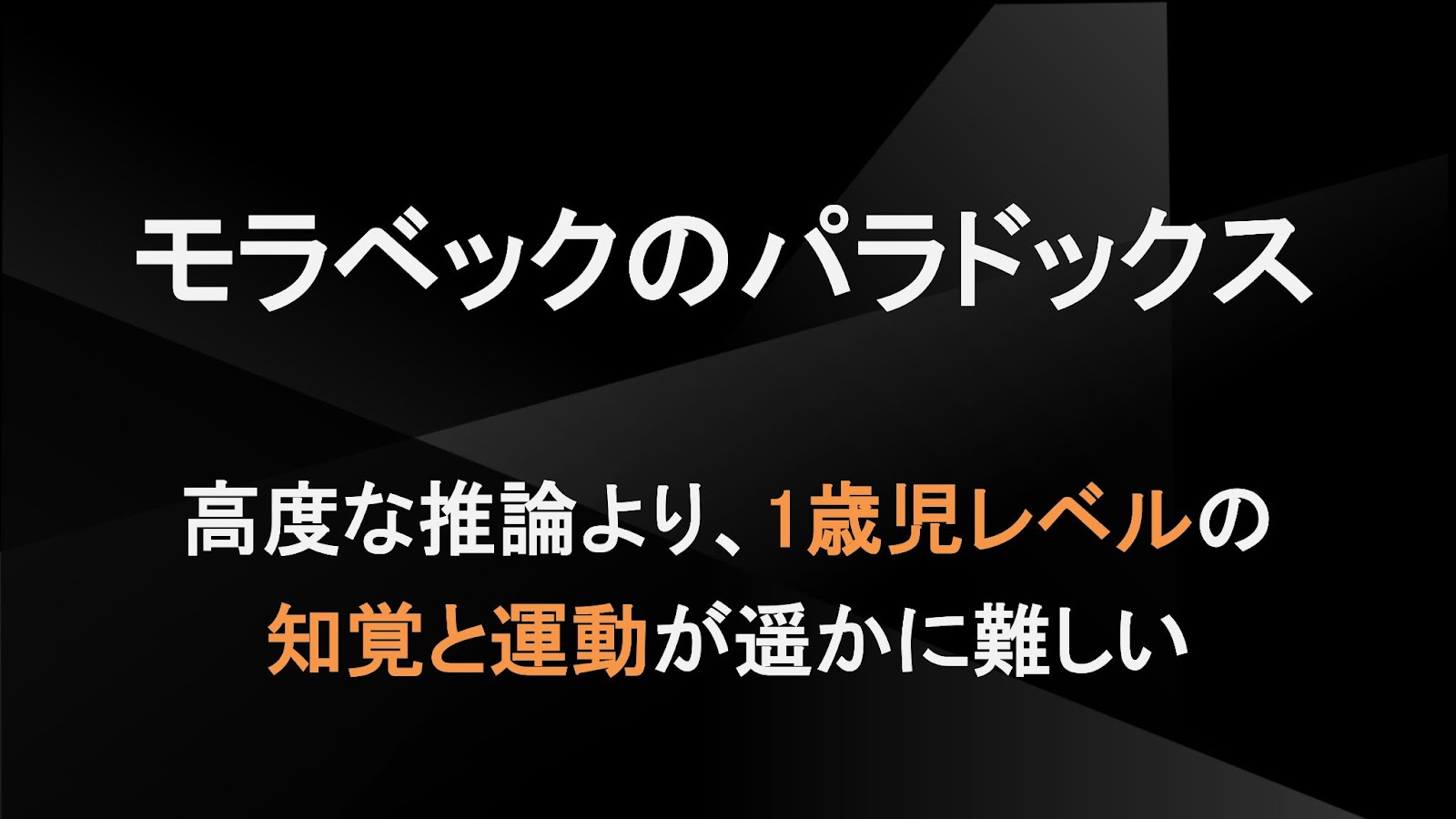

これは「モラベックのパラドックス」と呼ばれていて、AIやロボットの世界では1歳児レベルの知覚と運動の再現すら難しいと言われています。

▶モラベックのパラドックス(Moravec’s paradox)とは?(ITmedia 会員限定記事)。

よく見ると、確かに実用的なユースケースにまだまだ落とし込まれていないと感じます。

FingerVisionは「画像」で触覚を再現

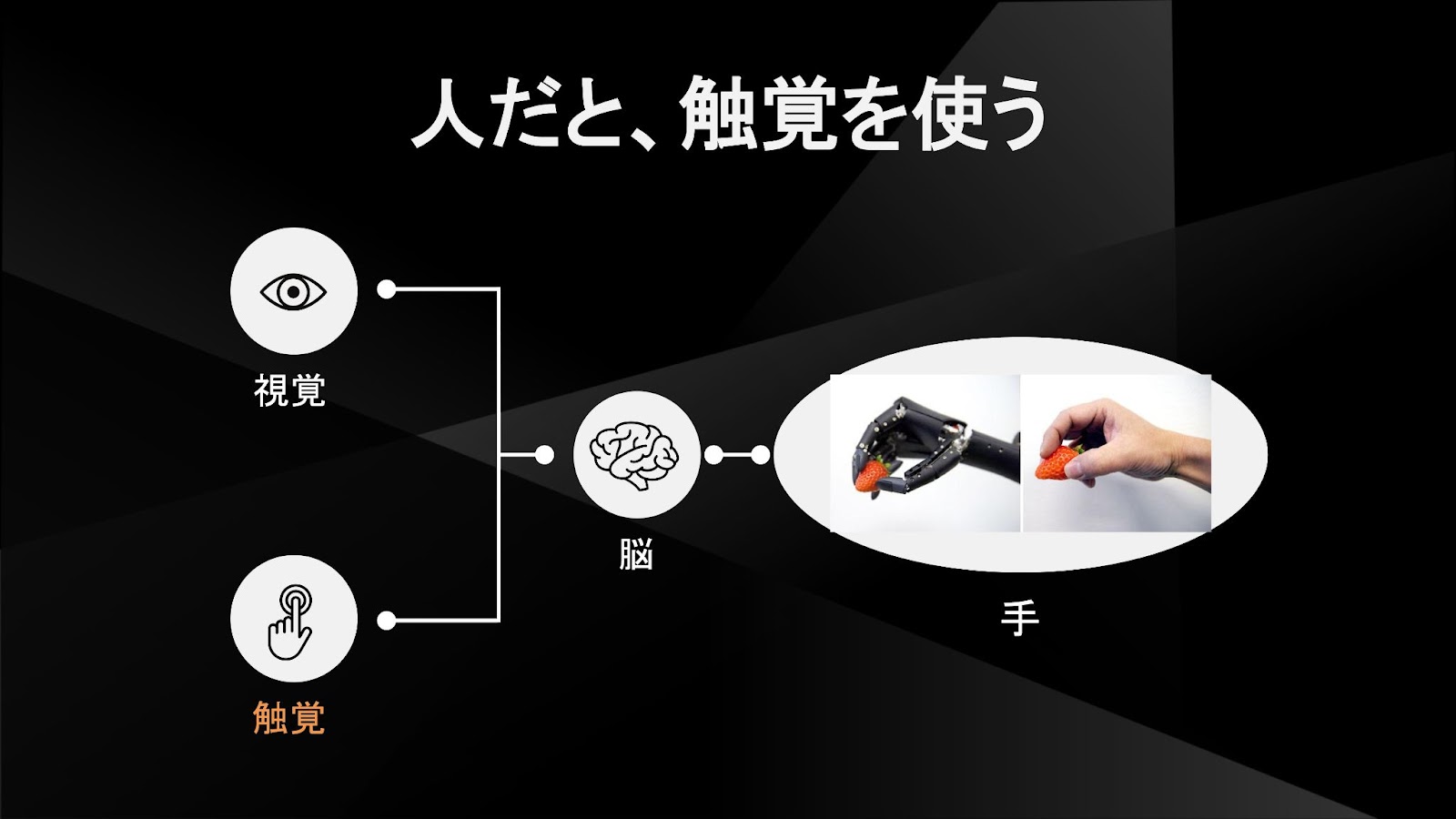

では、人間だとどうやっているかというと、「触覚」を使っています。

これは無意識のうちにやっています。

触覚の有用性はロボットの世界も同じで、かれこれ30年ぐらいずっと研究されていますが、なかなか実用性は出てきていません。

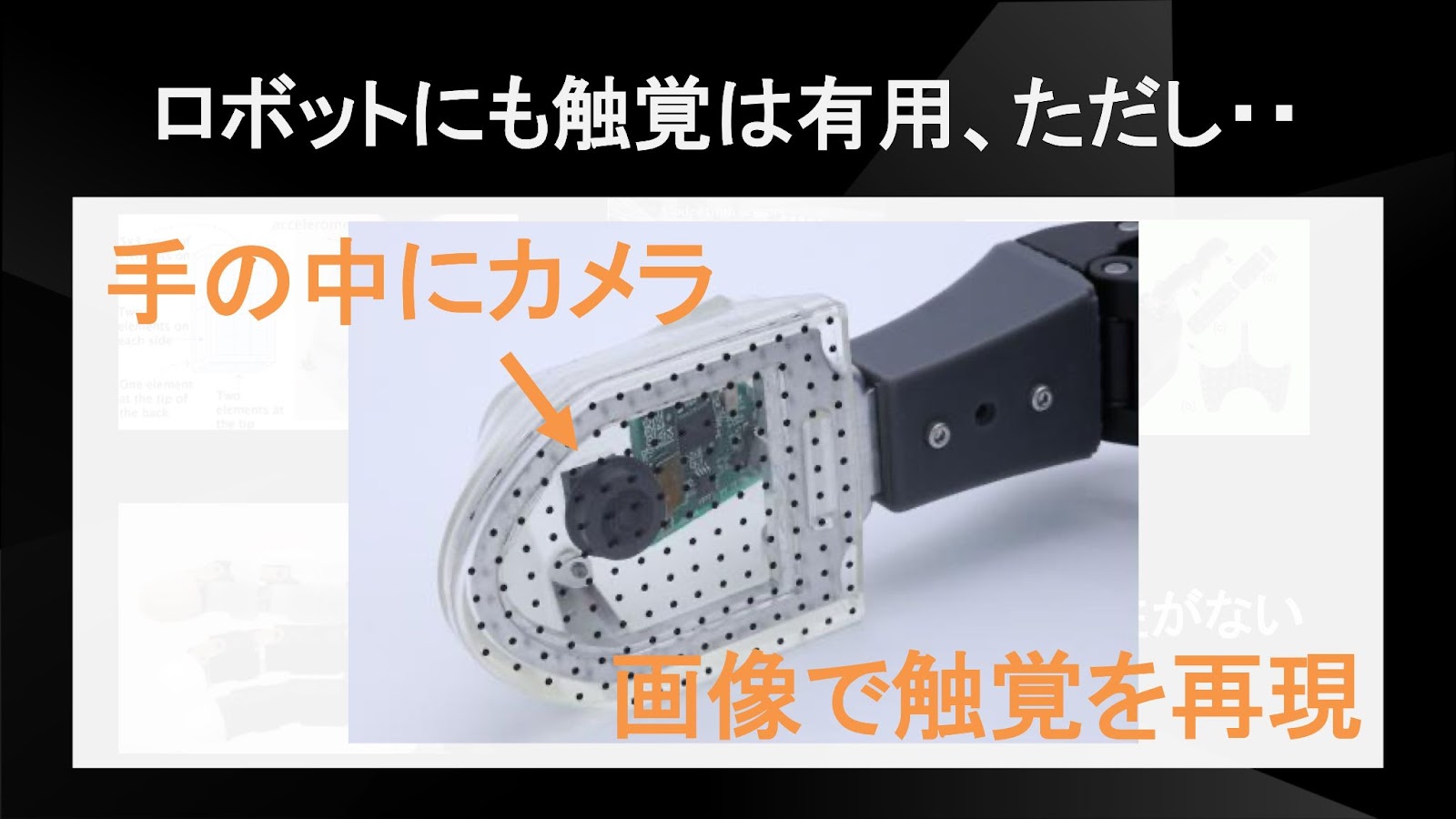

そのような中、当社は、手の中にカメラを付けて画像で触覚を再現するというアプローチを取っています。

このアプローチの良い点は、画像処理によって色々な触覚の情報を再現することです。

滑りや堅さなど多岐にわたる触覚情報を、画像というワンソースで再現できます。

それによって、多機能、頑丈、安価という、本来であればトレードオフになるものをひとまとめに提供できるので、非常に実用性が高い技術になっています。

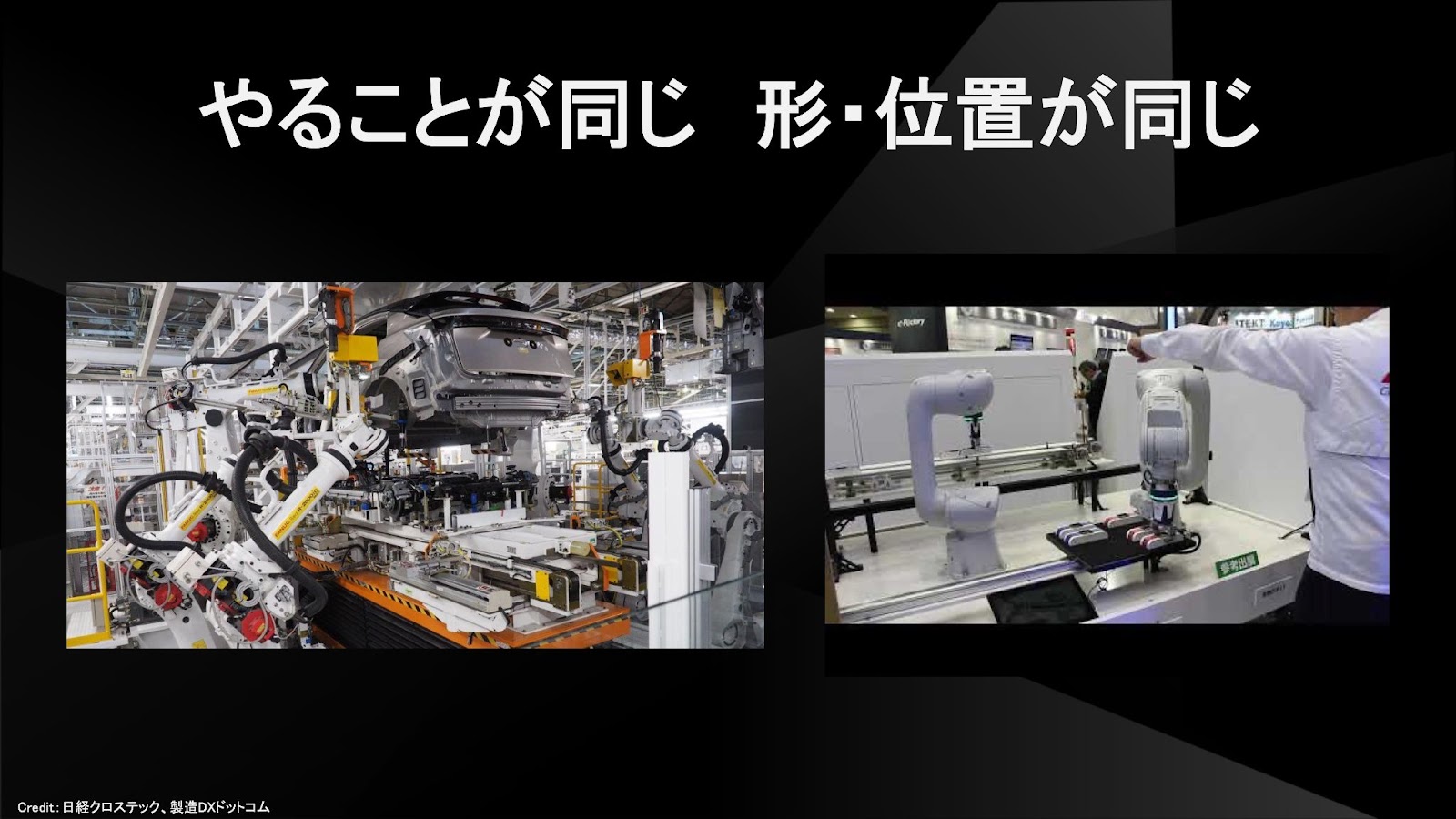

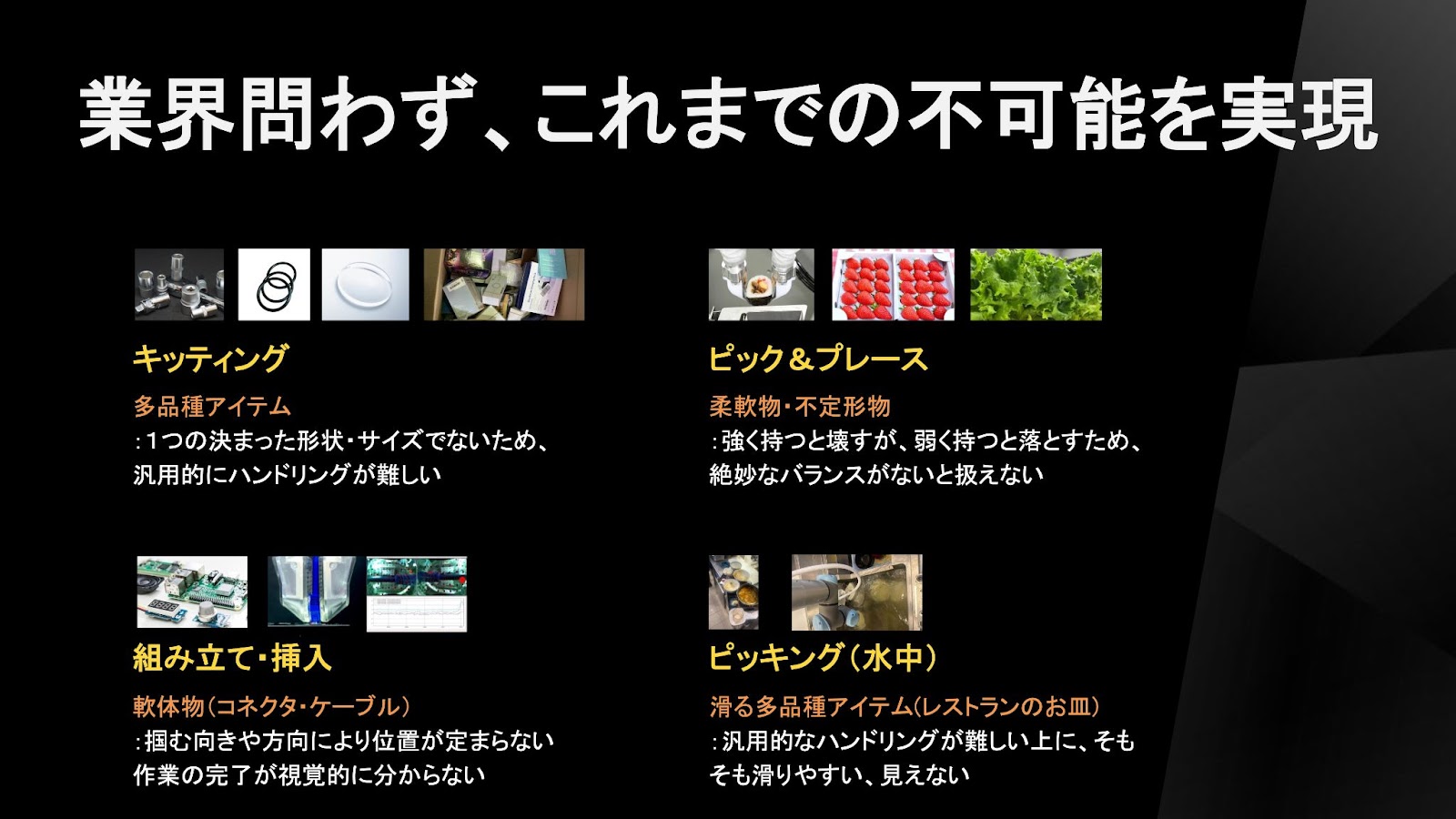

これまでのロボットができることは限定的

これを使ってどうしましょうか?

基本的にこれまでのロボットは、やることが同じで、形や位置が同じものでしか使えないことが多いです。

極めて限定的な場面でしか使われてこなかったのが、ロボットです。

「触覚」の実装で不可能を可能に

では、FingerVisionはどうするかというと、「触覚」の特徴を十二分に活かします。

例えば、ケーブルを挿し込んだ時、引っかかったなという感覚が人間にはありますが、ロボットにはその感覚がありません。

蓋閉めも同様です。

また、人間が柔らかいものを持つ時は、無意識のうちにいい感じの感覚で持っています。

これも触覚がないとできないことです。

画像から触覚を再現する自社技術をふんだんに駆使し、業界問わず今までなかなか難しいと言われていた不可能な領域を片っ端から突破している、そんな会社がFingerVisionです。

弁当の盛り付けや食器洗浄を自動化

例えば、食品を扱うことはロボットの世界では難易度がMax中のMaxですが、形がバラバラなおかずの盛り付けを自動化するソリューションを提供しています。

▶食品工場のお弁当盛付工程へ、触覚センサ付ロボットを複数台導入(FingerVision)

飲食店のさまざまな種類、さまざまな汚れが付着した使用済み食器の洗浄作業を自動化できます。

▶吉野家と食器洗浄ロボットの共同開発契約を締結(FingerVision)

こういったものを扱って、洗浄工程を自動化するソリューションを出しています。

販売実績も非常に多岐にわたっています。

CES2025でInnovation Awardを受賞

グローバルで見ても、触覚機能をロボットに実装した例はありません。

それもあって、今年のCES(CES2025)でInnovation Awardを受賞しました。

▶FingerVisionの触覚ロボット、CES Innovation Awards®を受賞(FingerVision)

売上は、今期4年目で数億円に達しました。

本当にあらゆる業界で使えるので、TAMがとにかく大きいところが良い点かなと思っています。

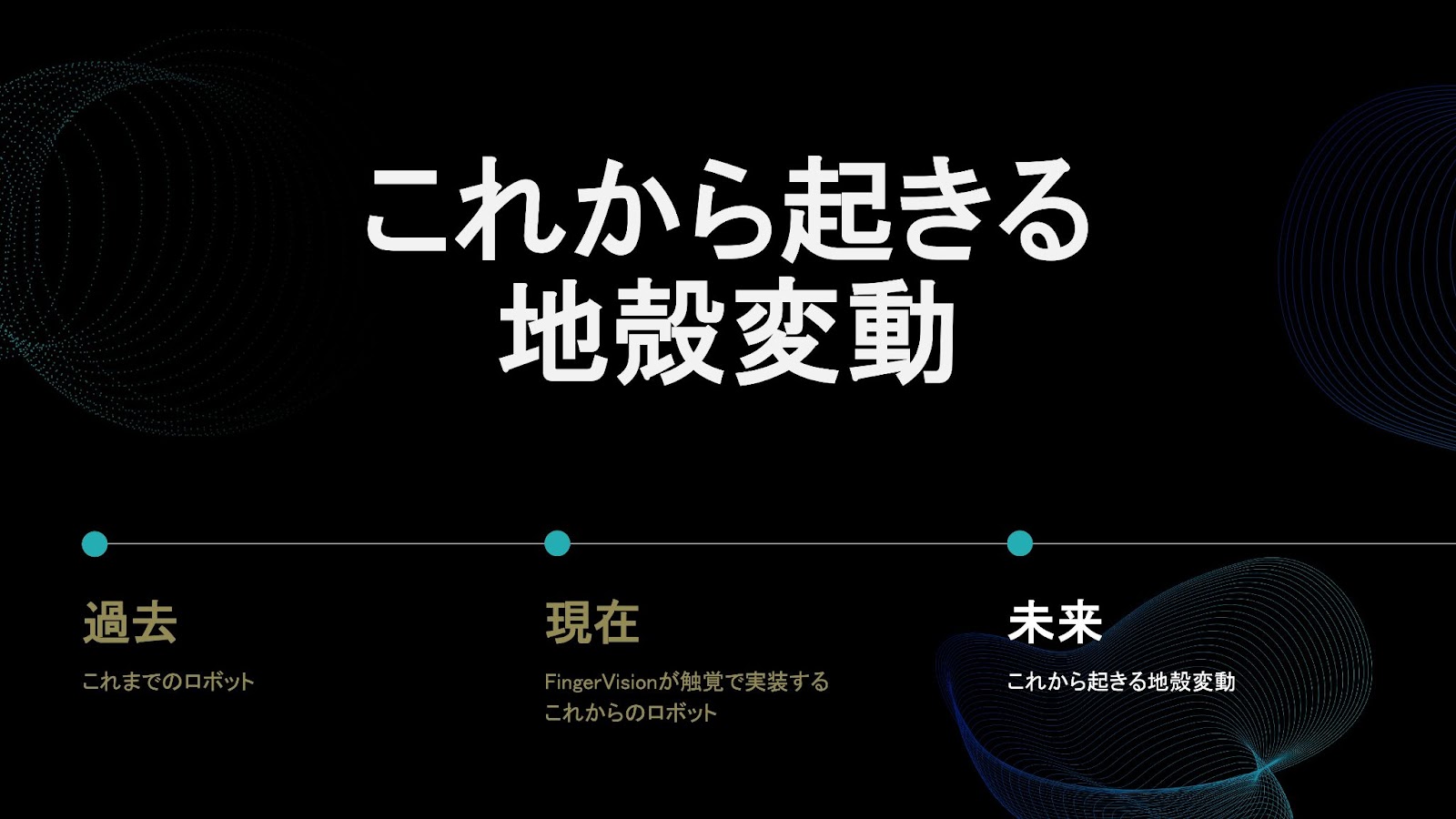

NVIDIAのCEOがCES2025で語ったこと

こういった技術を活用して、これから起きる地殻変動にどう向かうか。

ここは切っても切り離せないところですが、時価総額で世界トップになった企業と言えば、

NVIDIA、半導体メーカーです。

半導体は、AI開発において根幹となる技術です。

今年のCESで、NVIDIAのジェンスン・ファンCEOが基調講演を行いました。

▶CES 2025:AI は「驚異的なペース」で進歩していると NVIDIA の CEO が語る(NVIDIA | Japan Blog)

一番ハイライトして語っていたのは何か。

「Physical AI」です。

ロボットが自ら行動指針を決める段階へ

つまり、ロボットが自ら行動指針を決めるぐらい賢くなる段階にどんどん入っていこうとしています。

これは実際にやろうとすると、リアルの世界を再現しないといけないので、想像を絶するデジタルツインが必要になります。

しかし、それをやろうとし、今まで無理だと言われていた、AIに現実世界を理解させる世界が来ています。

ロボット開発をBig techが後押し

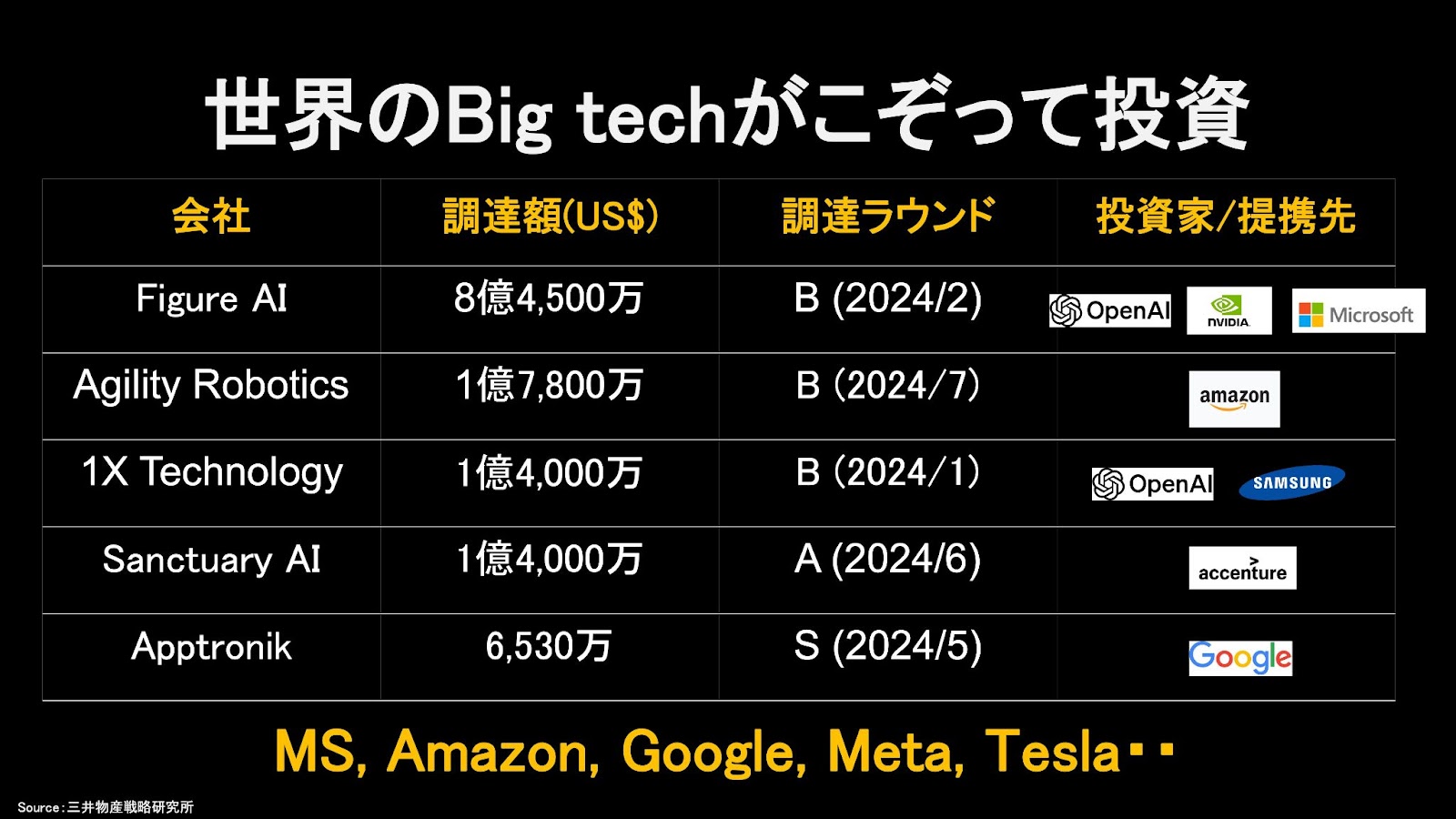

実際、この1年間でもヒューマノイドに対して開発投資が非常に進んでいて、スタートアップだけで30億ドルの投資がなされています。

世の中のBig tech、GAFAMやテスラはこの領域にこぞって投資をしています。

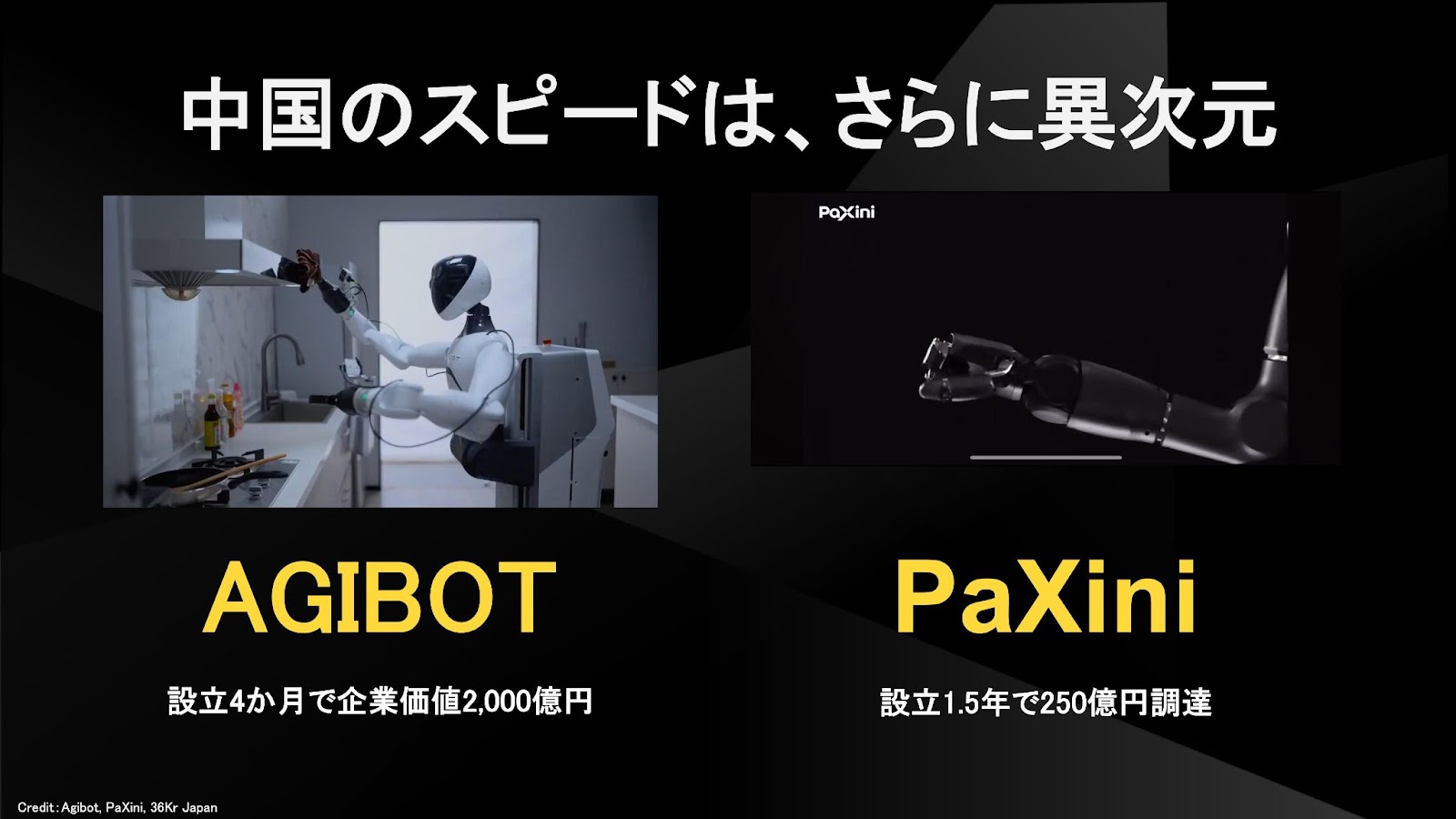

中国のスピードは、さらにすごいです。

設立数カ月でユニコーンのような会社も出てきていて、異次元のスピードです。

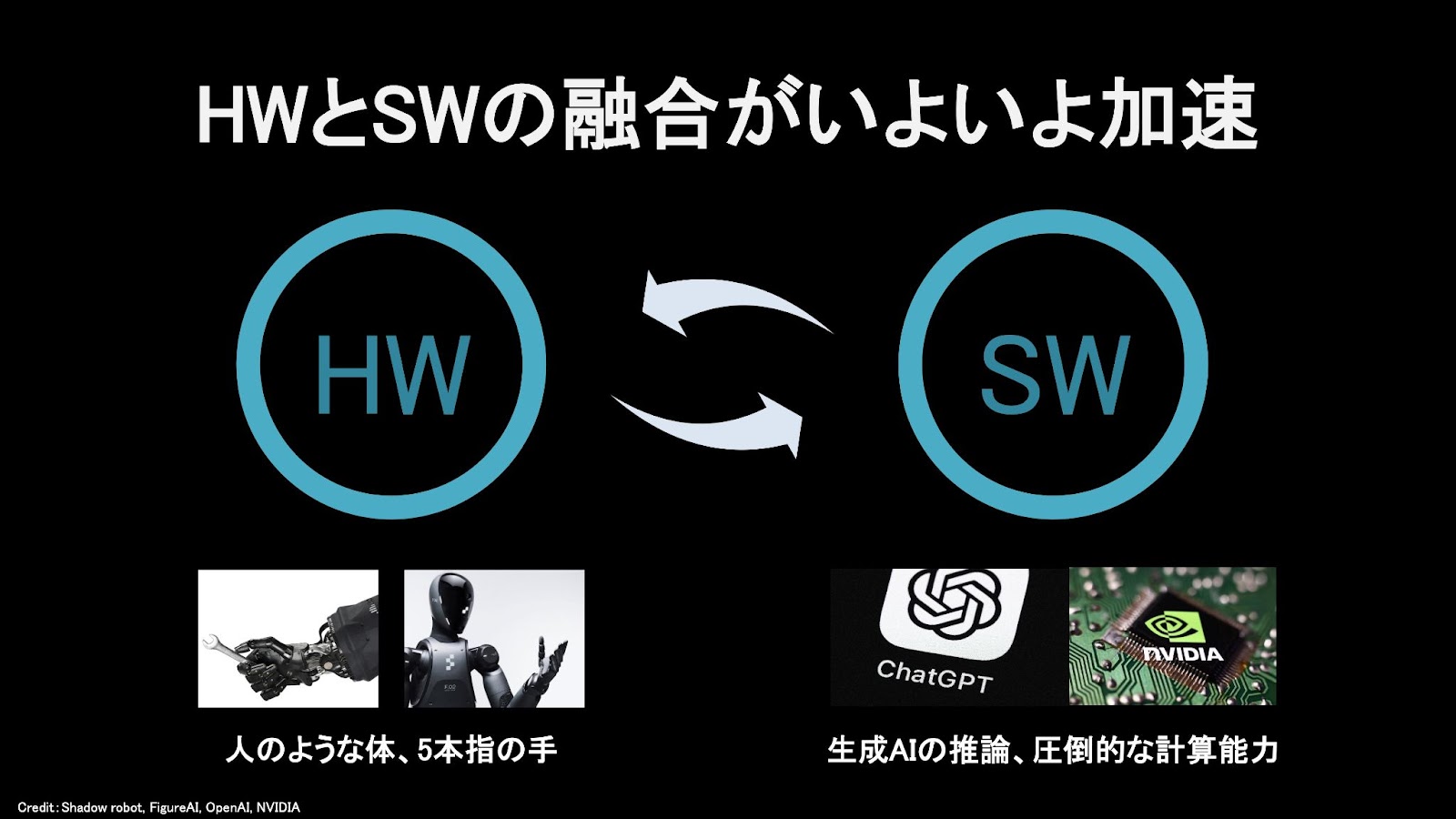

つまり、ハードウェアとソフトウェアの融合がいよいよ現実のものとなってきて、これを常に使いこなすような、身近なものになってきているのです。

実際、皆さんの身の回りに汎用ヒューマノイドロボットがいる、これが現実になる日が来ます。

不足しているのは資金だけではない

しかし、米中の異次元の資金流入は、日本とは桁が違います。

「どうする日本!」と心の中で叫びたくなるのですが、壁があるのです。

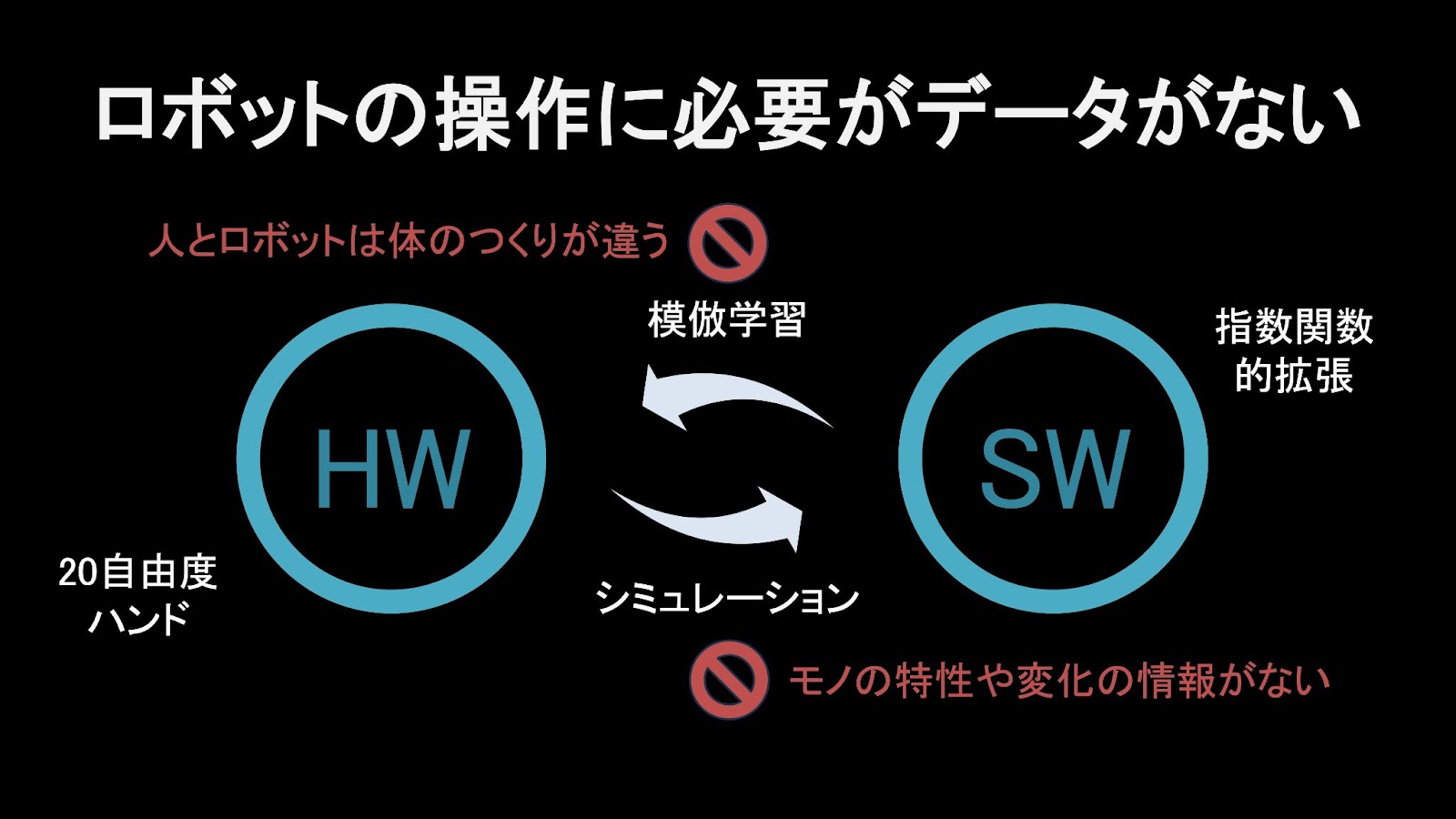

色々なデータを複製することはできますが、ロボットの物体操作に本当に必要なデータがないのが現状です。

1つは、シミュレーションをしようとしても、物の連続的な変化の挙動を示すデータ/モデルが足りない点です。

デジタルの世界でシンボル的に定義されるものと実際のリアルの世界で起きている連続的な事象を統合するためには、センシングで得られる情報量が圧倒的に足りないのが現実です。

これがないので、データを拡張しても不十分ですし、模倣学習もうまくいかない可能性が高いです。

もう1つは、模倣学習をしようとしても、人間とロボットはそもそも骨格・自由度が圧倒的に違うので、人の模倣データをもとに、同じような動作をロボットにさせようとしても、ハードウェア的に絶対無理があります。

データ不足の課題を「触覚」で解決

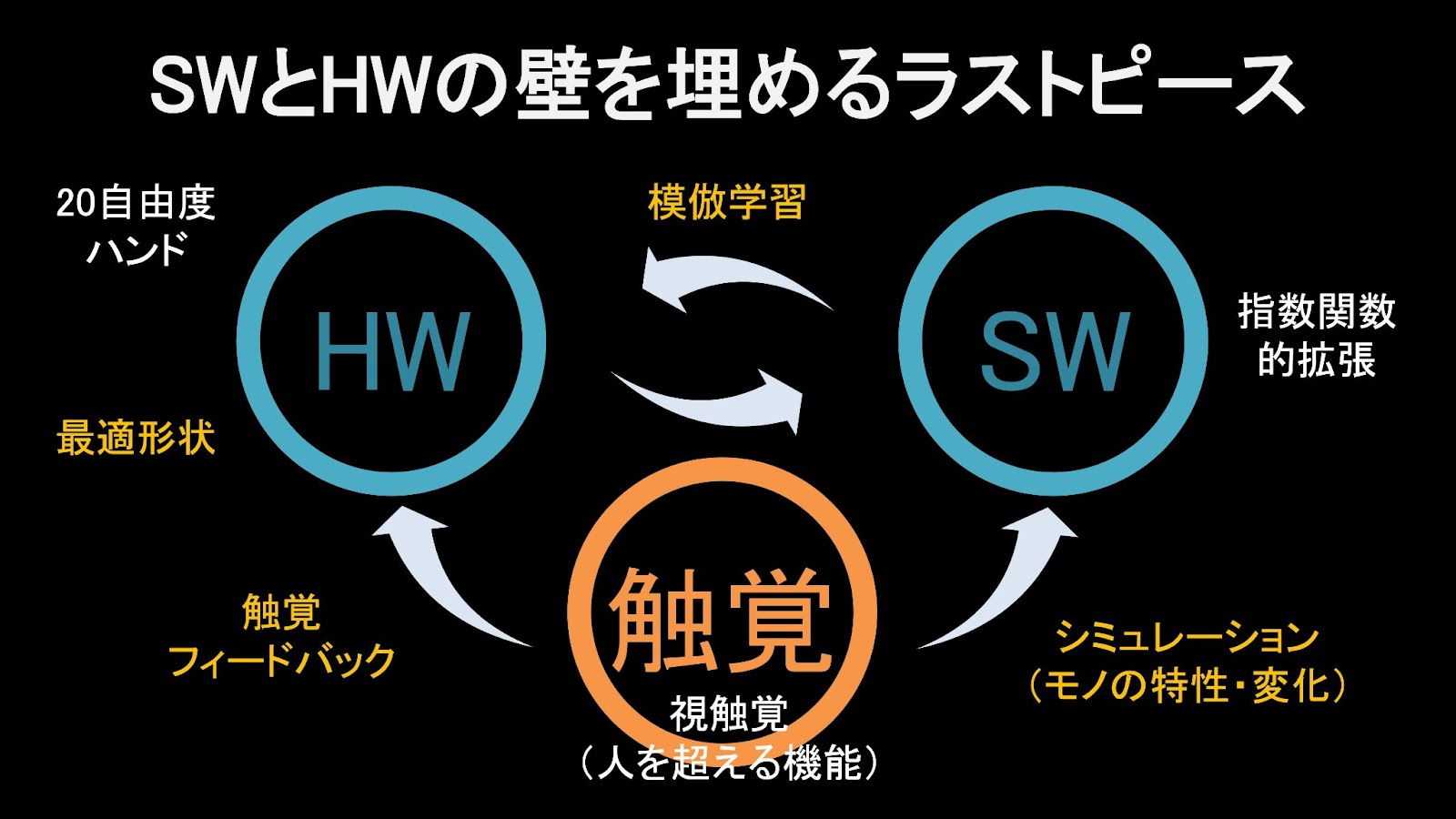

こういったものを突破するのが「触覚」です。

触覚の技術を使うと、まずシミュレーションの質が格段に上がります。

それによって模倣学習の質も上がります。

さらには、そのデジタルを介するループとは別に、ハードウェア側に直接触覚フィードバックを返すことによって、直接的に物体操作ができるのです。

これは、人間が感覚でやっている状況に非常に近いです。人間も頭の中で深く考えて手を動かすことよりも、何も考えずに「条件反射的に」無意識のうちに動いていることが多いと思いますが、そういった動き方に近い制御も可能になります。これができると必ずしも膨大な計算能力が必要なくなり、非常に実践的な方法を提示できます。

つまり、当社の技術が、ソフトウェアとハードウェアの壁を埋めるラストピースになるのです。

ロボット革命の中心にFingerVision

ヒューマノイドロボット競争の先に、近い将来、企業が「あれ、いい手(触覚)がない」とおそらく気づくはずです。 これから起きるロボット革命の中心にFingerVisionがいます。

今回のロボット革命は、まさに産業革命に匹敵するほどの大きな変化を世の中にもたらすでしょう。1人1台、1家に1台ロボットがある、そんな世界がすぐそこまで来ています。

そんな大きな時代の転換点で、最も付加価値が高い「手」にフォーカスし、

グローバルのフロントランナーを走るのが、FingerVisionという会社です。

もちろん我々だけでは、この大きなチャレンジを突破することはできません。

是非、多くの皆様との協奏・連携のもと、日本のAI・ロボットに残された最後のチャンスを形にしていきましょう!!

どうもありがとうございました。

(終)

▶カタパルトの結果速報、ICCサミットの最新情報は公式Xをぜひご覧ください!

▶新着記事を公式LINEで配信しています。友だち申請はこちらから!

▶過去のカタパルトライブ中継のアーカイブも見られます! ICCのYouTubeチャンネルはこちらから!

編集チーム:小林 雅/浅郷 浩子/小林 弘美/正能 由佳/戸田 秀成