▶カタパルトの結果速報、ICCサミットの最新情報は公式Xをぜひご覧ください!

▶新着記事を公式LINEでお知らせしています。友だち申請はこちらから!

▶ICCの動画コンテンツも充実! YouTubeチャンネルの登録はこちらから!

ICC FUKUOKA 2025のセッション「大人の教養シリーズ 人間を理解するとは何か? (シーズン13)」、全5回の②は、このセッション初参加、チューリングの青木 俊介さんが登場。自動運転車を作る青木さんは、AIやChatGPTに向き合う日々で、出力と入力の「間」に知性はあるのかと問います。登壇者たちの答えは? ぜひご覧ください!

ICCサミットは「ともに学び、ともに産業を創る。」ための場です。そして参加者同士が朝から晩まで真剣に学び合い、交流します。次回ICCサミット KYOTO 2025は、2025年9月1日〜9月4日 京都市での開催を予定しております。参加登録は公式ページをご覧ください。

本セッションのオフィシャルサポーターは EVeM です。

▼

【登壇者情報】

2025年2月17〜20日開催

ICC FUKUOKA 2025

Session 2E

大人の教養シリーズ 人間を理解するとは何か? (シーズン13)

Supported by EVeM

(スピーカー)

青木 俊介

チューリング

共同創業者 / 取締役CHRO

石川 善樹

公益財団法人Well-being for Planet Earth

代表理事

井上 浄

リバネス

代表取締役社長 CCO

中村 直史

五島列島なかむらただし社

代表 / クリエーティブディレクター

(モデレーター)

村上 臣

スマートニュース

VP of JP Product

▲

▶「大人の教養シリーズ 人間を理解するとは何か? (シーズン13)」の配信済み記事一覧

自動運転車を作るチューリング青木さん

青木 俊介さん(以下、青木) ぶっ飛んだテーマ設定とぶっ飛んだメンバーなので、すごく大変だなと私も感じています。

▼

青木 俊介

チューリング株式会社

取締役 共同創業者

米・カーネギーメロン大学 計算機工学科で博士号取得。米国では自動運転システムの開発・研究に従事し、サイバー信号機の開発や大手自動車メーカーの自動運転システムの開発に携わる。21年4月、国立情報学研究所 助教として着任し、青木研究室を主宰。 21年8月、将棋AI「Ponanza」の開発者の⼭本⼀成とチューリング株式会社を共同創業。 名古屋大学 客員准教授・JSTさきがけ研究員を兼任。MITテクノロジーレビュー『Innovators Under 35 Japan』選出。

▲

私も博士号を持っており、もともと自動運転システムやコンピューターサイエンス関連で、アメリカでモノを作っていたのですが、日本に帰ってきて、チューリングという会社を立ち上げました。

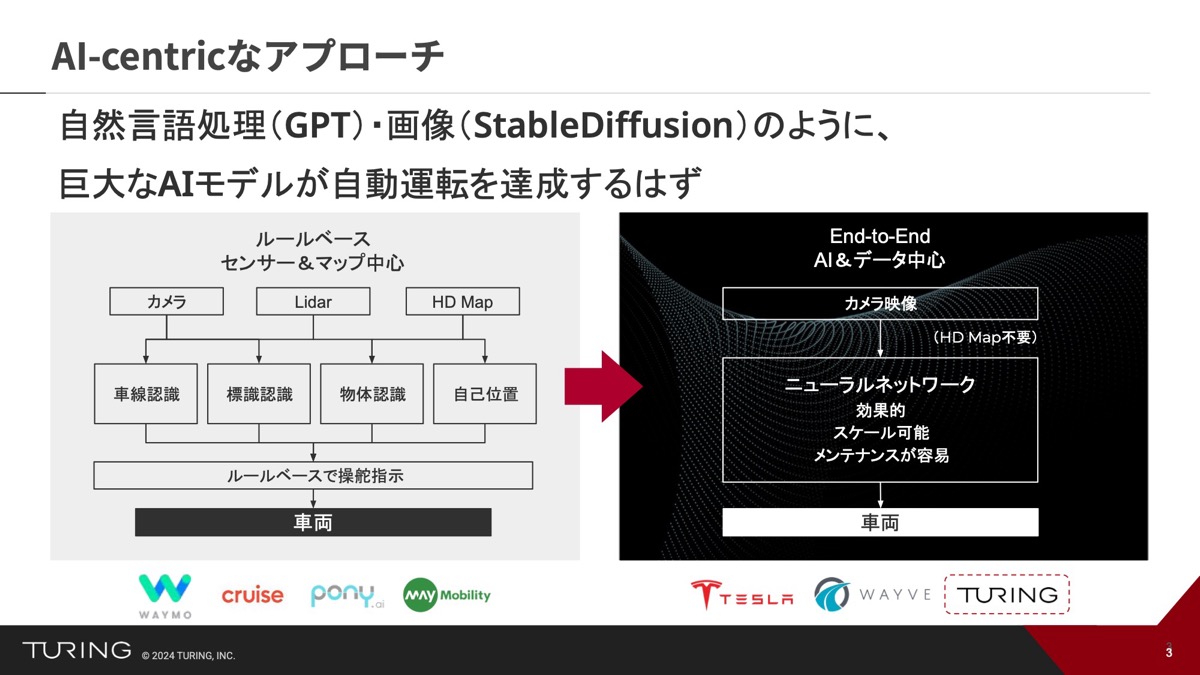

スライドの左側は、アメリカで私が作っていた自動運転システムで、ライダーセンサなど色々な情報がたくさんクラウドから入ってきて、ルールを一つひとつ決めていくというものです。

例えば、車の周りに人がいたとして、その距離に合わせて車のスピードを調整するなどです。

そうしていくと、やることは無限にあります。

犬が道路に飛び出したという状況に対応するには、犬に関するコードを書かないといけないわけです。

それを知らない人からすると、「犬が見えるようになった、昨日より進歩している、いいね」と思いますが、ソースコードが膨れあがってしまい、無限に続きます。

そろそろAIが全てしてくれる時代が来るのではないかと思ったので、日本に帰ってきて、チューリングという会社を経営し始めました。

スライドの右側は、今、我々の会社で行っているアプローチです。

カメラ画像を見てニューラルネットワークが全て計算をし、その結果を受けて車が動きます。

石川 組織と同じですね、どんどんルールが増えていくのは。

青木 そうなんです。

石川 「ルール増えたな!」と、おじさんは喜びますよね(笑)。

村上 ルールを守っているか、と。

青木 ルールの積み上げが大事だと。

井上 ルールがあると、きっと生きやすくなるのでしょうね。

村上 分かりやすくなりますよね。

車の中で完結し、その場で判断するような自動運転システムを作られているのですね。

開発チーム自ら驚く自動運転システム

青木 皆さんもChatGPTを使っていると思います。

使っている側からすると、「ブラックボックスになっていて、オープンAIずるい!」と思うかもしれません。

我々もAI自動運転システムを作っているのですが、AIエンジニアも中身が全部わかっているわけではないし、進捗に日々驚いています。

▶︎編集注:ここで会場では、開発中の運転システムによる動画が投影されました

ハンドル、アクセル、ブレーキについては、人がオーバーライドできる形になっています。

動画の中で「止まった」と言っているのは、開発チームのトップです。

村上 中の人が驚いてしまっているということですね(笑)。

青木 こちらは、何かバグが起きたと思ったら、実は、青の矢印の信号に反応していた例です。

一時停止からの発進の動画をお見せします。

井上 中の人が一番驚いていますね(笑)。

村上 面白いですね。

青木 今、「発進もするんですか?」と言ったのが、開発を引っ張ってくれている人です。

その、開発をしている当人ですら、「こんなことが起きるのか」と驚いているというわけです。

こちらは、歩行者認識システムです。

動画内で驚いたり、話しているのはメディアの人たちではなくて、みんな、開発陣です。

ChatGPTは知性を持っているのか?

青木 今日持ってきた内容は、「知性とは何か」です。

私は毎日考えているのですが、ChatGPTはそもそも知性を持っているのだろうか?

持っている気がするけれど、持っていると言うのは不安なので、持っているとは言えない。

知性は観測可能なのか?

持っているかどうかは置いておいて、出力されたものを見て、調べただけ、文章を作っただけだとは思わず、知性として見られるのかどうか。

そして、人類を超える知性は出現するのか?

これは、最近よく言われる問いですね。

AGI(Artificial General Intelligence、汎用人工知能)は出現するかどうか、私自身は出現すると思っていますが、出現しないだろうと思っている人もいます。

ChatGPTが人間っぽくて怖い瞬間

青木 1つ目の問い、ChatGPTが知性であるかどうかについて、私は毎日疑問に思うわけです。

石川 先日出た、ChatGPTのdeep research(ディープリサーチ)の機能は、知性を超えている気がしますけどね。

▶︎人類は勝てない? ChatGPTで本格調査レポートを作成「deep research」を試した(Impress Watch)

青木 超えていますよね、あれがあると、普通に仕事がなくなりますよ。

石川 そうなんですよね、すごいと思います。

村上 「知性とは何か」という、深い話ですよね。

青木 そうです。

村上 新しいものを作り出すのが知性だとしたら、ChatGPTはどうなのだろうと思います。

ディープリサーチは、タスクを自動で行ってくれますよね。

面白いのが、寄り道をするところです。

例えば、ゲームのウェブサイトを見て一休みすることもあります(笑)。

「さぼってるじゃん」と思うのですが、自分たちだって、仕事をしている時に息抜きをすることがありますよね。

井上 あいつら、ゲームするわけですね(笑)。

村上 ゲームしたり、休憩したり、全然関係ないサイトを見てウロウロしたりです。

石川 何をしているのか、作業プロセスは出てきますからね。

村上 そうそう、でもパッと見て、「さぼってる?」と思って。

でも、我々もずっと、100%で集中しているわけではないですよね。

だから、あれを見た時に、人っぽいと感じてちょっと怖かったのです。

井上 無駄を使えるんだ。

村上 そうそう。

無駄な寄り道からゴールに向かっているプロセスを見て、知性があるかもと思い始めましたね。

愛や知性は観測可能か?

井上 自ら何かをする、という主体性という点ではどうでしょう。

そういうベクトルがあるのかどうか。

中村 直史さん(以下、中村) 先ほどの自動運転については、実装した覚えがないものが機能し始めているということですか?

青木 実装した覚えがないというよりも……例えば、ChatGPTも、バージョンが上がると、できるようになることが増えますよね。

あれはおそらく狙ったわけではなく、サイズを大きくする、パラメータを変えてみるなどをして、すごいものができたら、それを世の中に出しています。

そのプロセスの実情をお見せしたということです。

中村 なるほど。

青木 ルールを積み上げると分かりやすいという話をしましたが、その開発方法だと、信じてくれる人からお金を集めて、信じてくれる人たちで開発した結果、できなかったというケースが生まれます。

一方、思っていた線よりも上振れすることもあります。

例えば、先ほどの赤信号での再発進は、上振れです。

あれを以て知性と呼ぶのかと問われたときに、知性は持っていないと意地悪に言いたくなるのですが、知性の定義ができていないと、知性を持っているように見えてしまうと思います。

これは、投げ込みです。

村上 なるほど。

観測可能性とリンクすると思うのですが、AIに東大のテストを受けさせたり、医学試験をクリアさせたりしても、仕組みとしては、AIは理解をしていないですよね。

基本的には確率統計で、次に来るものを予測した結果、答えに辿り着いてしまったという、結果論のように見えます。

これはどう考えればいいのか、未だにモヤモヤしています。

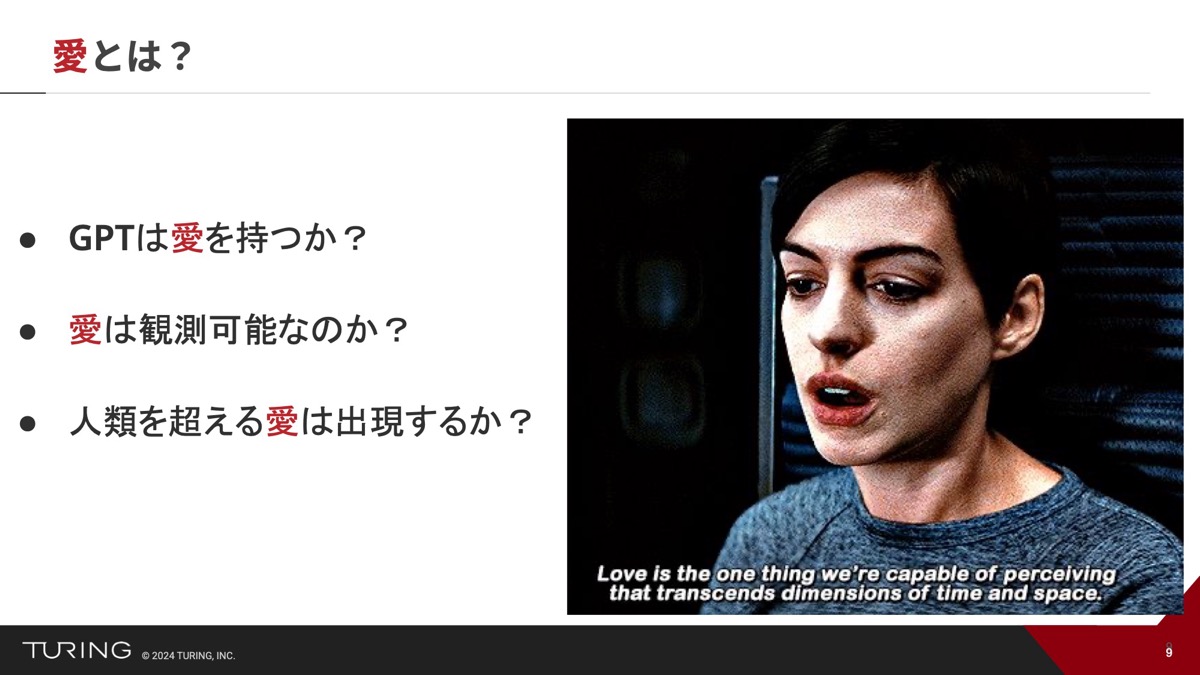

青木 愛についても、同じだと思います。

僕が一番好きな映画『インターステラー』の中で、愛は自分たちで発明したものではないと語られます。

ネタバレにならないように気をつけて話しますが、愛は「自分たちで発明したものではないので説明はできないが、時間も空間も超え、そこにあるものなので観測可能である」とされます。

登場人物が、「誰かを愛していることは、観測はできるけど説明はできない」と言うわけです。

ChatGPTが愛を持つかと言うと、持っていないとみんな思うと思います。

でも、今日は、AIが愛を持てないのは事実なのか、愛と知性は観測可能かを問いかけたいです。

私は、愛と知性は観測可能だと思っており、観測可能であれば存在すると考えています。

人類を超える愛が出現するかと言うと、出現しなさそうだが、観測可能であれば出現するのではないかと思います。

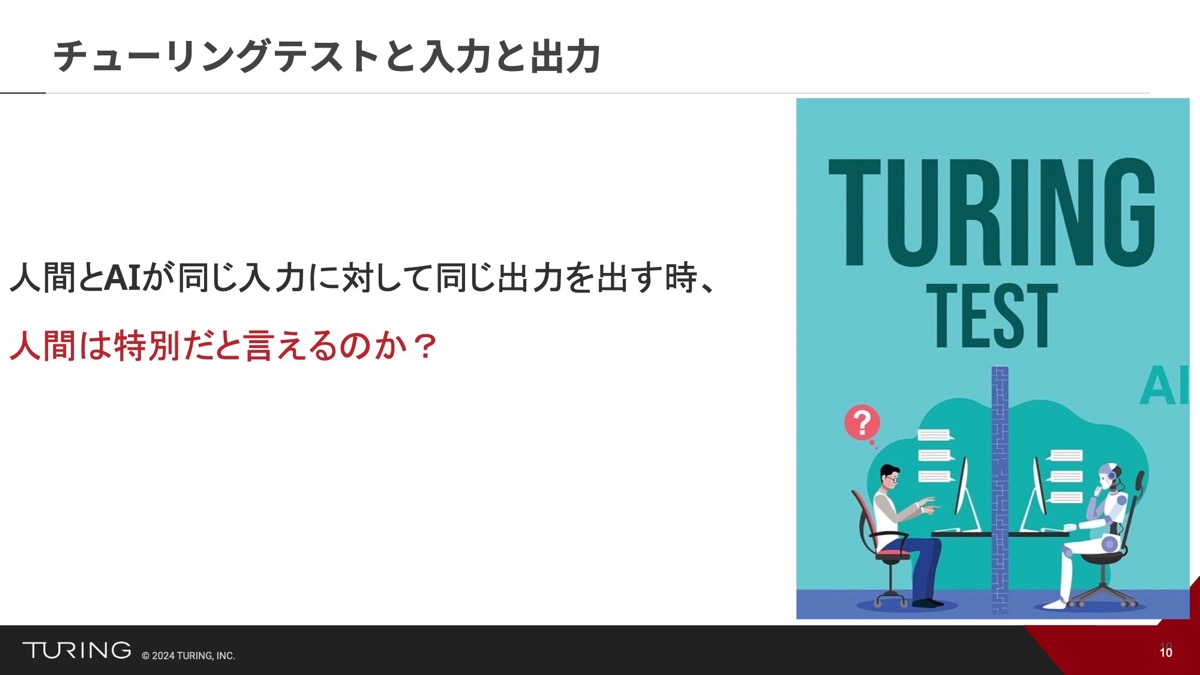

僕が今日のテーマ「間」を聞いた時、AIの中の中間表現を考えました。

これは人間に例えると脳のことです。

AIは、数字のベクトルとしての中間表現を持っています。

中間表現について深掘りをしようと思っていましたが、逆に、入力による出力があったとすると、間にあるのは人間ですよね。

その人間が、機械もしくはAIになった時、入力と出力が同じだとすると、中が同じでいいのかと思いました。

皆さんが、この話をどう膨らませてくれるのかは分かりませんが……。

入出力だけで判断するのには違和感

村上 これについて考えたことがあります。

昔の、タモリさんの有名なコントがあります。

自動改札機の中にタモリが入って、切符を受け取って出すというものですが、機械の入力と出力と同じですよね(笑)。

▶︎【タモリさん】新・日本の最先端 自動改札機の最先端技術【ヨルタモリ】(YouTube)

あれはどうなんだ、と。

あと、チューリングテストについても、実は裏で人が回答していましたというフェイクもありました。

▶︎チューリングテストとは | 2014年「合格」疑惑の意味と真相・AIにもたらす影響を解説(Ledge.ai)

どうなんでしょう、入出力だけで判断するというのは、個人的には違和感を感じますね。

製麺機に名前を貼ったら人になった

中村 全然違う話になってしまうかもしれませんが、僕は五島列島から参加しています。

五島列島には五島うどんという名産品があり、「ますだ製麺」という製麺所があります。

その製麺機を取材させてもらったことがあるのですが、昔は人の手で伸ばしていた麺を、今は人気がありすぎて機械と人で伸ばすようになったらしいのです。

僕が工場を取材させてもらった時、その機械に1枚、紙で人の名前が貼ってあったんです。確か「花子」だったと思います。

そして、ますだ製麺の前会長だった舛田安男さんは、「これは人だ」と言うのです。

井上 花子と一緒に延ばしていると。

中村 花子という紙を貼る前と貼った後が、製品の仕上がりが明らかに違うと言っていました。

なぜなら、機械に対する周りの態度が変わっているからです。

ちなみに、花子というのは、舛田会長の妻の名前だったと思います(笑)。

ですから、威厳があるわけです(笑)。

井上 あまりぞんざいには、扱えないわけですね(笑)。

中村 丁寧に扱わないといけないし、不真面目には働けない。

それを聞いた時、単なる笑い話とは思えないと感じました。

その機械は、本当は人なのではないかと。

それで今日のテーマについても、僕は、知性は存在するのではないかと感じています。

入力に対する出力は人によって違う

石川 今、この会場にいる我々はみんな、青木さんから同じ入力を受けているわけですよね。

それに対して、出力(青木さんの話をどう感じたか)は一人ひとり違います。

AIも同じで、同じ入力に対して同じ出力をしていると、人間ぽくないですよね。

同じ入力でも、毎回違う、多様な出力になると、人間ぽさをより感じるのだと思います。

中村 自動運転でも、暴走族のような運転をするとか?

石川 そうです!「花子」の例もそうで、使う人によって違う味になっているのだと思います。

その多様性を、舛田会長は見抜かれているのではないでしょうか。

中村 確かに。

石川 同じものを食べても、下から出る時は、腸内細菌等によって違うものになりますよね。

井上 全然違いますね。

石川 ですから、出力の多様性ではないでしょうか。

村上 それは面白いですね、確かに均一ではない。

井上 入力についても、今は視覚情報や文字かもしれませんが、これからは五感など入力情報も増えていくと思います。

それがないことによる、不思議さは現れるのでしょうか?

青木 今、ロボットと自動車の領域にAIがあまり入ってきていない理由があります。

身体性という単語を使うのですが、小さな子供は、物を投げたり、口に入れたりしますよね。

大人からすれば意味が分からない行動ですが、あれは何かを獲得している過程だと思います。

いまのところのAIは、例えば、殴れば痛いことが分からない、左と言ったとき、左という概念が分からないのです。

「左に寄って」と指示しても、頭の軸から見て90度横を指すのか、それとは違うところを指すのかが分からないということです。

自然言語処理というか、辞書の中でも、「左」や「右」を説明するのは難しいのです。

石川 世界には、左右の概念を持たない民族もいます。

彼らには、東西南北の概念しかないので、左と言っても分かりません。

▶︎世界の見方が変わる5つの言語について(Gigazine)

井上 絶対値ですね。

村上 確かに、数についても「1、2、3、いっぱい」という概念もありますよね。

井上 そこの東、ということですね(笑)。

石川 そうそう、「北へ寄ってください」とか(笑)。

(続)

▶カタパルトの結果速報、ICCサミットの最新情報は公式Xをぜひご覧ください!

▶新着記事を公式LINEでお知らせしています。友だち申請はこちらから!

▶ICCの動画コンテンツも充実! YouTubeチャンネルの登録はこちらから!

編集チーム:小林 雅/小林 弘美/浅郷 浩子/戸田 秀成